Das deutsche Gesundheitswesen steht vor vielfältigen Herausforderungen: Immer mehr Patient*innen treffen auf einen zunehmenden Fachkräftemangel, während Diagnostik und Therapie komplexer werden. Die Vielzahl, häufig unstrukturierter, Informationen ist für Behandelnde kaum noch überschaubar. Gleichzeitig sollen die Patientensicherheit gestärkt, der Kostendruck bewältigt und der Anspruch auf Mitbestimmung in der Gesundheitsversorgung gewährleistet werden. Es braucht also effektive Lösungen, um diesen vielschichtigen Herausforderungen zu begegnen. In der Industrie wird im Umgang mit ähnlichen Herausforderungen vielfach auf künstliche Intelligenz (KI) gesetzt. Seit der Veröffentlichung von ChatGPT, 2022, haben insbesondere Large Language Models (LLMs) große Aufmerksamkeit gewonnen. Die Anzahl der Nutzer*innen und die Vielfalt der Anwendungen im privaten und beruflichen Gebrauch steigen stetig. Dieser Beitrag beleuchtet, welche Chancen LLMs im Gesundheitswesen bieten – von der automatisierten Dokumentation bis zur Unterstützung in Forschung und Diagnostik. Gleichzeitig wird die unverzichtbare Auseinandersetzung mit Risiken wie Halluzinationen und Bias diskutiert, und gezeigt, welche Lösungen das Fraunhofer IESE bereits heute entwickelt.

Von Chatbots zu Healthcare-Agenten

LLMs sind große Modelle aus dem Bereich der künstlichen Intelligenz (KI), die natürliche Sprache verarbeiten und produzieren können. Daher werden sie zum Bereich der generativen KI gezählt. Näheres zur Funktionsweise dieser großen Sprachmodelle erklären wir in unserem Beitrag »Wie funktionieren LLMs? Ein Blick ins Innere großer Sprachmodelle«. Der wohl bekannteste Anwendungsbereich sind sogenannte Chatbots wie z.B. ChatGPT. Benutzer*innen können damit per Text kommunizieren, Fragen stellen und Aufgaben wie Textverarbeitung erledigen lassen. Die Texteingaben werden als sogenannte Prompts an die Modelle übergeben und von diesen verarbeitet.

Prompts sind allerdings nicht auf den Einsatz durch manuelle Eingabe von Menschen beschränkt. Als sogenannte Agenten können, auch innerhalb einer Software, verschiedene Komponenten durch selbst erzeugte Prompts miteinander kommunizieren, einander Aufgaben erteilen oder Eingaben von externen Systemen erhalten und verarbeiten. Dies eröffnet ein riesiges Spektrum an Einsatzmöglichkeiten, auch für Digital Health und das Gesundheitswesen.

Reduzierung des Dokumentationsaufwands

Einen großen Mehrwert bietet die Übernahme von Aufgaben im Bereich der Dokumentation. Laut einer Studie mit Ärzt*innen in einem regionalen Schwerpunktkrankenhaus beträgt die tägliche Dokumentationszeit durchschnittlich mehr als 1,5 Stunden. Das entspricht fast 20 % der Arbeitszeit. Darunter fallen auch standardisierte Berichte, welche stattdessen von spezialisierten LLMs verfasst werden könnten. So ist es z. B. möglich, aus Notizen, medizinischen Dokumenten und Daten der Krankenhaus- oder Praxisinformationssysteme, automatisierte Fallberichte zu generieren. Dies stellt eine zeitliche und mentale Entlastung für Ärzt*innen dar, wodurch den Patient*innen eine größere Aufmerksamkeit geschenkt werden kann.

Solche Ansätze werden bereits umgesetzt, z. B. durch diverse Lösungen für die automatische Erstellung von Arztbriefen. In Verbindung mit Sprache-zu-Text Technologien ergeben sich für LLMs weitere Anwendungsfelder. Z. B. können Arzt- oder Anamnesegespräche aufgezeichnet und direkt mithilfe von LLMs analysiert, zusammengefasst oder strukturiert werden. Die wichtigsten Informationen können in geeigneter Form abgespeichert und weitergeleitet werden. Das erspart Dokumentationsaufwand und kann Prozessabläufe beschleunigen. Wird im Gespräch eine direkte Anschlussuntersuchung beschlossen, kann das beteiligte Personal direkt informiert werden, um Vorbereitungen zu treffen. Funktionierende Anwendungen, die Arztgespräche aufnehmen und in übersichtlicher Form, zuverlässig zusammenfassen können, existieren ebenfalls bereits.

Entsprechende Anwendungen können durch Automatisierung im Krankenhaus- oder Praxisalltag, für ein hohes Maß an Entlastung sorgen.

Vereinfachter Informationsfluss

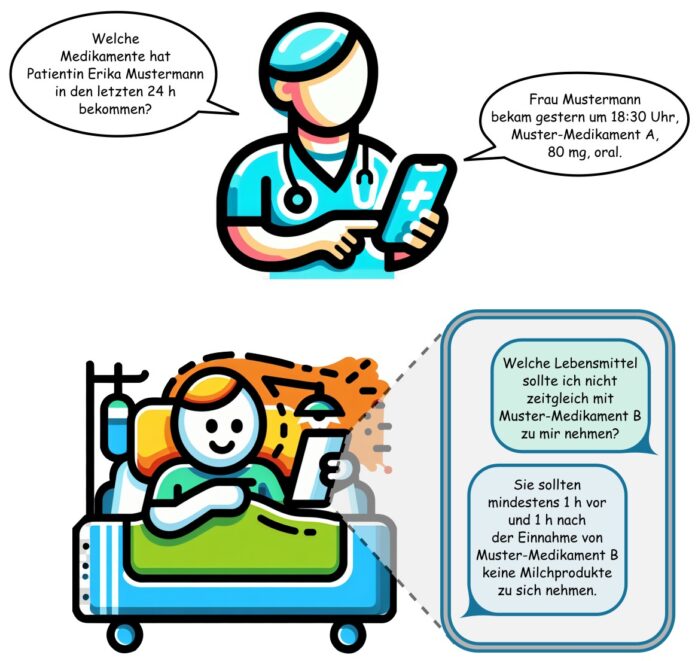

Des Weiteren kann die Arbeit für Krankenhaus- oder Pflegepersonal durch Sprachassistenten in Verbindung mit LLMs erleichtert und effizienter gestaltet werden. Z.B. können Informationen zu einzelnen Patient*innen als sogenannte »Knowledge Graphen« gespeichert werden. Dies sind Datenstrukturen, die Informationen und deren Beziehungen zueinander als Knoten und verbindende Kanten darstellen. Ist der Sprachassistent entsprechend mit diesen Graphen vernetzt, können schnell Informationen, bspw. zur Medikation oder zu Allergien, durch das Personal erfragt werden. Diese Informationsbeschaffung als Gespräch zu gestalten, ermöglicht einen besonders niedrigschwelligen Zugang.

Nicht nur zur Steigerung der Effizienz und Sicherheit von Krankenhaus- oder Praxisprozessen können LLMs im Gesundheitsbereich von Nutzen sein. Es ist auch möglich, dass Patient*innen selbst Informationen zu ihrer Erkrankung oder deren Behandlung in Erfahrung bringen. Spezialisierte, LLM-basierte Chatbots können zur Beantwortung der aufkommenden Fragen genutzt werden. Hierzu lassen sich LLMs z. B. mit Wissensdatenbanken verbinden, die große Mengen an medizinischem Wissen bereithalten und die auf Grundlage der neuesten fachlichen Erkenntnisse aktualisiert werden. Die Antworten können durch das LLM dem Wissensstand der Patient*innen angepasst werden, sodass sie für verschiedene Zielgruppen verständlich und nachvollziehbar sind.

Um die Kommunikation zwischen Fachpersonal und Patient*innen zu verbessern, können digitale Sprachtools zu Dolmetscherzwecken genutzt werden, aber auch, um fachspezifische Aussagen in alltägliche, für Laien verständliche Sprache zu überführen.

Sprachmodelle in der Diagnostik

Abgesehen von den eher praktischen Anwendungen, kann generative KI aber auch für fachspezifische Herausforderungen, wie Diagnosen, unterstützend eingesetzt werden. Zum einen ermöglichen Techniken wie Retrieval Augmented Generation (RAG), Datenbanken nach relevanten Informationen zu durchsuchen und ergänzende Hinweise zu möglichen Erkrankungen zu geben. Auch die Sicherheit von Patient*innen kann hiervon profitieren, indem gleichzeitig bspw. aktuelle Erkenntnisse zu Arzneimittelinteraktionen geprüft werden. Des Weiteren können LLM-basierte Analysetechniken angewendet werden, um Diagnosen zu unterstützen. Z.B. ist es möglich, LLMs bei der Erkennung von neurodegenerativen Erkrankungen einzusetzen, indem mit ihrer Hilfe ungewöhnliche Sprachmuster identifiziert werden.

Abgesehen von natürlicher Sprache, können die methodischen Prinzipien der LLM-Technologie auch für die Verarbeitung anderer Arten von Zeichenabfolgen angewendet werden. Diesen Umstand macht man sich zum Trainieren von speziellen LLMs zunutze, die die »Sprache der Gene« verstehen, sogenannte »genome language models« (GLMs). Das Genom kann, durch eine Abfolge von Buchstaben dargestellt werden. Diese geben die Sequenz der Basenpaare auf den DNA-Strängen an und repräsentieren den genetischen Code. Mithilfe solcher Modelle könnten z. B. genetische Risikofaktoren für bestimmte Erkrankungen bei Patient*innen identifiziert werden.

Unterstützung in der medizinischen Forschung

Neben dem direkten Einsatz im klinischen oder Praxisalltag bieten LLMs auch wesentliche Vorteile für die medizinische Forschung.

Die Fülle an medizinischer Fachliteratur macht den Zugang und Einstieg in viele Themenbereiche schwer und zeitintensiv. Mithilfe von LLMs lassen sich Recherchen vereinfachen und beschleunigen, indem sie hilfreiche Übersichten und Zusammenfassungen zu einzelnen Dokumenten oder ganzen Themengebieten erstellen. Sie ermöglichen auch spezifische Rückfragen und sind, anders als Lehrpersonal, durchgehend verfügbar. Hierbei ist jedoch anzumerken, dass insbesondere Detailaussagen in Originalliteratur gegengeprüft werden sollten, um auszuschließen, dass die weitere wissenschaftliche Arbeit möglicherweise auf Falschaussagen durch das KI-System basiert.

Neben der Erschließung von Literatur können LLMs auch beim Verfassen neuer Literatur behilflich sein. Z.B. haben Forschende die Möglichkeit, Manuskripte über ihre Arbeit stichwortartig aufzusetzen und den ersten Entwurf eines Volltextes durch ein LLM schreiben zu lassen. Dieses bedarf anschließend intensiver inhaltlicher Prüfung und Anpassung. Dennoch kann so der Schreibprozess beschleunigt werden, was den Forschenden mehr Zeit für andere, forschungsrelevante Aufgaben verschafft.

Für viele Aufgaben im wissenschaftlichen Bereich ist es notwendig, oder von Vorteil, Programmierkenntnisse zu besitzen. Dies kann im Zentrum der Forschung stehen, wenn es bspw. um die Entwicklung und Auswertung komplexer Simulationen zur Ausbreitung von Medikamenten im Blutkreislauf o.Ä. geht. Außerdem kann es dabei helfen, langwierige, repetitive Aufgaben, wie die Übertragung und Verarbeitung biomedizinischer Messwerte aus verschiedenen Datenquellen, zu automatisieren und somit Zeit zu sparen. Ähnlich wie mit gesprochenen Sprachen können LLMs auch auf Programmiersprachen trainiert, und die Codeinhalte mit inhaltlichen Aussagen verknüpft werden. Die Verwendung von generativer KI als Programmierassistent kann die Entwicklung von Code daher deutlich erleichtern und beschleunigen. Zudem gibt es Forschenden mit geringen Programmierkenntnissen die Möglichkeit, dennoch funktionalen Code für ihre individuellen Zwecke zu generieren.

Was ist beim Einsatz von LLMs im Gesundheitswesen zu beachten?

Ein Bewusstsein für Risiken und Einschränkungen ist essenziell.

Es geht um Patientensicherheit

Neben vielfältigen Vorteilen und Anwendungsmöglichkeiten sind wichtige Risiken und Herausforderungen bei der Verwendung von LLMs im Gesundheitswesen zu beachten.

Zunächst ist besonders in diesem Bereich ein sehr hohes Maß an Verlässlichkeit und Absicherung unverzichtbar. Das gilt insbesondere für Aufgaben mit Patient*innenbezug. Da hier Verantwortung für die Gesundheit der Patient*innen übernommen werden muss, dürfen keine Entscheidungen allein den KI-Modellen überlassen werden. Doch selbst wenn LLMs keine endgültigen Diagnosen stellen oder Entscheidungen über Weiterbehandlungen treffen, beeinflussen sie den Entscheidungsprozess. Sie verarbeiten und liefern zentrale Informationen, die für die ärztliche Entscheidungsfindung relevant sind.

Diese Prozesse müssen absolut verlässlich sein, um die Patient*innen nicht zu gefährden. Aus diesem Grund sollten hier nur medizinisch spezialisierte LLMs oder spezialisierte Systeme, in die sie eingebettet sind, verwendet werden. Diese verbinden ein fundiertes Training in medizinischen Fachbereichen und Terminologien mit einem ausgeprägten Schwerpunkt auf Sicherheits-, Datenschutz- und Risikomanagement. ChatGPT 4 besteht zwar bereits die US-amerikanische medizinische Zulassungsprüfung mit hoher Punktzahl. Doch die fundierte und verantwortungsvolle Behandlung von Patient*innen ist weitaus komplexer als solche Prüfungen. Auf medizinische Themen spezialisierte LLMs sind u. A. Med-PaLM, Meditron, medBERT oder ClinicalCamel.

LLMs können halluzinieren

Ein bekanntes Phänomen, das ein besonderes Risiko im medizinischen Bereich darstellt, sind sogenannte Halluzinationen. Davon spricht man, wenn LLMs plötzlich falsche oder sinnlose Aussagen tätigen. Durch die riesigen Mengen an Trainingsdaten und Parametern ist es schwer zu prüfen, woher genau solche Halluzinationen stammen. Entsprechend schwer ist es, sie zu vermeiden. Allerdings gibt es inzwischen verschiedene Absicherungstechniken, durch die Halluzinationen abgefangen und korrigiert werden können. Dies kann z.B. durch Multiagentensysteme, bei denen sich verschiedene Agenten gegenseitig überprüfen, realisiert werden.

Generative KI kann Bias reproduzieren und verstärken

Ein weiterer wichtiger Faktor im Umgang mit künstlicher Intelligenz in der Medizin ist die Berücksichtigung von Verzerrungen und Ungleichheit. Viele Gruppen wie Frauen, People of Color oder Transpersonen sind in der medizinischen Forschung, die häufig auf weiße Männer ausgerichtet ist, unterrepräsentiert. Diese ungleiche Repräsentation spiegelt sich auch in Dokumenten und Daten wider, welche als Trainingsgrundlage für Sprachmodelle und andere KI-Systeme dienen. Dies kann zu falschen Behandlungen und Benachteiligungen dieser Gruppen führen und bedarf daher besonderer Aufmerksamkeit. Die unkritische Verwendung der Modelle reproduziert diese Verzerrung. Wenn sie als Grundlage für weitere Forschung und fortlaufendes Nachtraining der Modelle selbst dient, verstärkt sie diese sogar.

Kompetenzen können verloren gehen

Nicht zuletzt bringt die vermehrte Verwendung von Sprachmodellen auch die Gefahr von Kompetenzverlust mit sich. Wenn Fachpersonal sich vermehrt auf die Aussagen und Empfehlungen der verwendeten LLMs verlässt, kann dies langfristig die eigene Urteilsfähigkeit in fachbezogenen Aspekten negativ beeinflussen. Dasselbe gilt für Aufgaben, die nicht mehr, oder nur noch kaum selbst ausgeführt werden. Die Menschen verlernen diese mit der Zeit. Eine Studie des MIT beschreibt dieses Phänomen als »kognitive Schuld« und stellt einen negativen Zusammenhang zwischen der Verwendung von ChatGPT und den kognitiven Fähigkeiten der Studienteilnehmer*innen fest.

Die Verwendung von LLMs im Gesundheitswesen steht noch am Anfang

Obwohl LLMs teilweise hervorragende Ergebnisse in medizinischen Tests, sowie eine hohe Verlässlichkeit erzielen, wird die Anwendung im medizinischen Bereich, sowohl von medizinischem Personal als auch von Patient*innen, oftmals skeptisch betrachtet. Ein zentraler Aspekt für eine erfolgreiche, weitreichende Anwendung wird es also sein, die Systeme vertrauenswürdig umzusetzen und die auch zu demonstrieren. Um hier Vertrauen zu schaffen, ist es wichtig, dass transparent mit der Verwendung umgegangen wird, und, dass die Aussagen der KI-Komponenten nachvollziehbar und überprüfbar sind. Außerdem besteht eine zentrale Herausforderung darin, belastbare regulatorische Rahmenbedingungen für den Einsatz von KI in der Medizin zu schaffen, die sowohl Sicherheit gewährleisten als auch Innovationen fördern. Hierbei spielen auch Haftungsfragen eine zentrale Rolle.

Unter Beachtung dieser kritischen Aspekte und einem gezielten, verantwortungsvollen Umgang bietet der Einsatz von künstlicher Intelligenz in der Medizin wesentliche Vorteile, die bei der Bewältigung vieler Herausforderungen im Gesundheitswesen entscheidend sein können. Gerade der demografische Wandel und, damit einhergehend, der zunehmende Fachkräftemangel erfordern eine schnelle Veränderung. LLM-basierte Lösungen können hier für Entlastung sorgen.

Das Fraunhofer IESE bringt LLMs im Gesundheitswesen zum Einsatz

Das Fraunhofer IESE beschäftigt sich seit Jahren mit LLMs und setzt diese in Projekten wie SATURN ein. Hier werden Ärzt*innen mithilfe eines hybriden Ansatzes aus LLMs und anderen Methoden des maschinellen Lernens dabei unterstützt, seltene Erkrankungen zu diagnostizieren oder auszuschließen.

Aktuell arbeitet das Digital Health Engineering Team des IESE am Projekt FHIR-Starter. Hier werden LLMs in einem Multiagentensystem dazu verwendet, um unstrukturierte Daten aus medizinischen Volltextdokumenten wie Arztbriefen, zu extrahieren und in ein strukturiertes Datenformat zu übertragen. Das Zielformat entspricht den FHIR Spezifikationen, einem international etablierten Standard für medizinische Daten. Somit werden die Daten digital nutzbar und interoperabel, d.h. sie können von verschiedenen Systemen gelesen und interpretiert werden, wovon Patient*innen, medizinisches Personal und Forschende profitieren können.

FHIR steht für Fast Healthcare Interoperability Resources (Schnelle Ressourcen zur Interoperabilität im Gesundheitswesen) und bezeichnet einen internationalen Standard zum Austausch elektronischer Gesundheitsdaten, der stetig weiterentwickelt wird. Hierfür werden standardisierte Datenformate (z. B. JSON, XML) und ein modularer, erweiterbarer Aufbau verwendet.

Außerdem unterstützt das Fraunhofer IESE, im Rahmen der »LLM Innovation Labs«, Unternehmen bei der Integration von LLMs in eigene Produkte.

Die Weiterentwicklung von generativer KI schreitet schnell voran und spiegelt sich in der Veröffentlichung vieler neuer Versionen verschiedener Modelle im kommerziellen und Open Source Bereich wider. Dieser Prozess beschleunigt sich selbst, da mithilfe besserer Modelle auch schneller neue, bessere, effizientere Modelle entwickelt werden können. Es ist also davon auszugehen, dass sie auch im medizinischen Bereich zunehmend an Relevanz gewinnen werden.

Sie planen den Einsatz von künstlicher Intelligenz im Health-Bereich? Die Expert*innen des Fraunhofer IESE unterstützen Sie gerne bei der sicheren und verantwortungsvollen Integration von KI-Systemen. Nehmen Sie jetzt Kontakt mit unserem Digital Health Engineering Team auf, um Ihr Projekt zu besprechen.